Andrés Colmenares es el director del Máster en Diseño para una Inteligencia Artificial Responsable que se impartirá en la escuela Elisava. Le entrevistamos para que nos explique qué es una IA responsable, a qué perfiles va dirigido este máster, cómo afectará la IA a nuestras vidas y si la inteligencia artificial es solo un hype más.

Al contrario al uso común, mitificado y distorsionado de IA como una entidad única y autónoma, el término IA originalmente se refiere a un campo de estudio bastante amplio creado en los 50s. En la última década ha pasado de la teoría a la práctica gracias al incremento exponencial de la capacidad computacional disponible. En otras palabras, gracias a que cada día se construyen enormes y más centros de procesamiento de datos que usan millones de microprocesadores muy potentes financiados por grandes corporaciones. Para aterrizar esta idea podríamos utilizar la siguiente analogía para aclarar la relación entre una herramienta de IA concreta y bastante popular como ChatGPT y la IA; ChatGPT podría ser a la Inteligencia Artificial, lo que una marca de calculadoras avanzadas es a las Matemáticas. Explica Andrés Colmenares

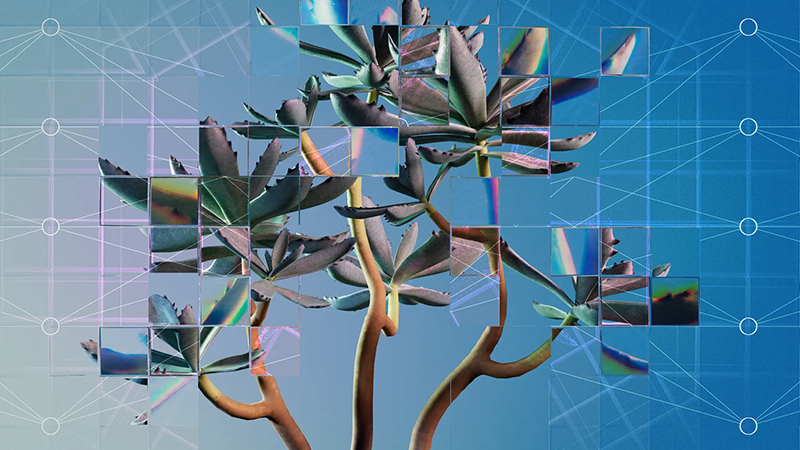

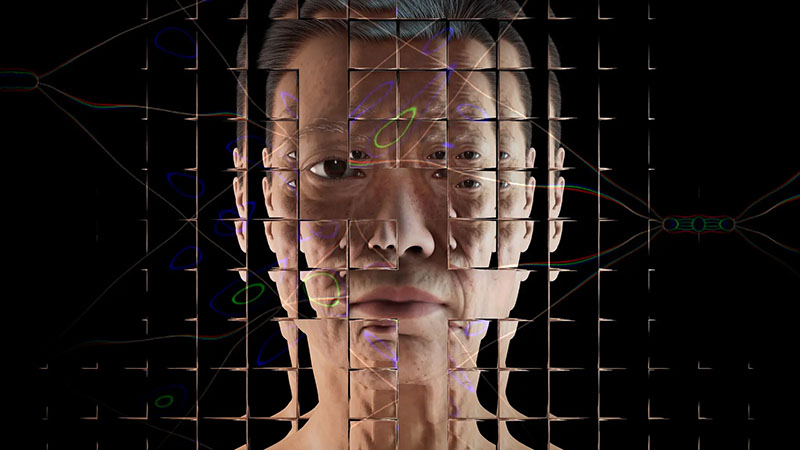

Imágenes superiores: 1) Image by Alan Warburton / © BBC / Better Images of AI / Nature / CC-BY 4.0 2) Image by Alan Warburton / © BBC / Better Images of AI / Virtual Human / CC-BY 4.0

En el master Diseño para una inteligencia Artificial Responsable me llama la atención la palabra “responsable” en el nombre de estos másters ¿Qué papel juega la responsabilidad en el uso de AI

Andrés Colmenares: La responsabilidad es un concepto relacional, es decir que a la hora de pensar en el papel que este valor juega o debería jugar en un contexto concreto, debemos pensar en quienes deberían ser responsables por las consecuencias del uso (o el diseño) de cualquier herramienta basada en Inteligencia Artificial (IA).

Aquí me gustaría hacer un pequeño paréntesis para aclarar que, contrario al uso común, mitificado y distorsionado de IA como una entidad única y autónoma, el término IA originalmente se refiere a un campo de estudio bastante amplio creado en los 50s que en la última década ha pasado de la teoría a la práctica gracias al incremento exponencial de la capacidad computacional disponible, y a la digitalización de nuestras vidas que mueve miles de millones cada segundo a través de la economía digital.

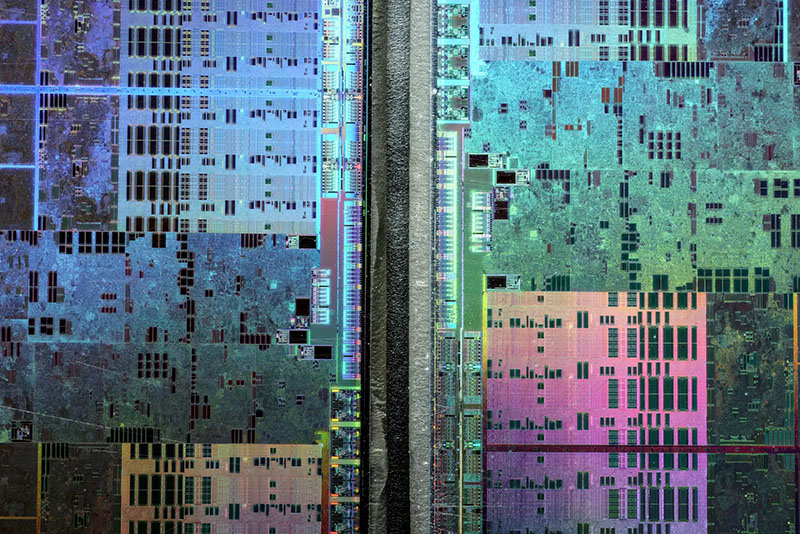

En otras palabras, gracias a que cada día se construyen más enormes centros de procesamiento de datos que usan millones de microprocesadores muy potentes financiados por los miles de millones que mueven las grandes corporaciones tecnológicas. Para aterrizar esta idea podríamos utilizar la siguiente analogía para aclarar la relación entre una herramienta de IA concreta y bastante popular como ChatGPT y la IA; ChatGPT podría ser a la Inteligencia Artificial, lo que una marca de calculadoras avanzadas es a las Matemáticas.

“ChatGPT podría ser a la Inteligencia Artificial, lo que una marca de calculadoras avanzadas es a las Matemáticas”.

Volviendo al papel de la responsabilidad en el uso de herramientas y sistemas basados en IA, debemos pensar en las consecuencias e impacto del uso de dichas herramientas. Si los fabricantes de estas “calculadoras” funcionan gracias a que usan contenidos sin permisos de sus creadores, o si usan conjuntos de datos con sesgos racistas o machistas a la hora de automatizar el proceso de asignación de una ayuda pública, o si el simple uso de una herramienta consume tanta electricidad como el sector de la aviación y por ende dispara por las nubes las emisiones de carbono, entonces podemos entender mejor que como sociedad debemos darle prioridad al diseño de mecanismos que fomenten una cultura de uso responsable de tecnologías por parte de los fabricantes y usuarios de estas herramientas.

Esto no es una idea nueva, ni una utopía. La responsabilidad se ha traducido en leyes, normativas y buenas prácticas que han favorecido cambios culturales en sectores como la alimentación, bebidas alcohólicas, la movilidad o el uso de armas entre otros. Por esta razón es importante entender y diferenciar la relación entre el auge de un campo del conocimiento como la IA, las corporaciones que están creando herramientas basadas en IA, las propias herramientas, y las empresas, gobiernos y ciudadanos que usan dichas herramientas para enmarcar quién es responsable y qué es un uso responsable de la Inteligencia Artificial.

¿Cómo se hace un uso responsable de la AI? ¿y cómo sería el uso de AI irresponsable? Nos das unos ejemplos

Andrés Colmenares: No existe un único uso responsable de la IA porque las implementaciones de este campo del conocimiento son muy amplias y variadas. Pero desde hace unos años está emergiendo un área de investigación desde varias universidades denominada “Responsible AI” o “Trustworthy AI” que ha sido adoptada en diversos proyectos alrededor del mundo para diseñar conjuntos de principios, marcos éticos y regulatorios desde el sector público y privado. Por ejemplo la Comisión Europea ha estado trabajando en un marco jurídico sobre la IA que parte de una serie de directrices basadas en principios éticos como el respeto de la autonomía humana, prevención de daños y riesgos, la equidad y la explicabilidad, particularmente importante en usos de herramientas basadas en IA para automatizar la toma de decisiones. Incluye también requisitos como la supervisión humana, la solidez y seguridad técnica, transparencia, privacidad en el uso de datos, evitar la discriminación en dichos datos y medir el impacto ambiental que el uso de dichas herramientas puede tener antes de usarlas.

Desafortunadamente el uso irresponsable de la IA en varios ámbitos, pero en particular en el sector público es bastante común y termina afectando a las poblaciones más vulnerables. Para conocer ejemplos concretos en el contexto local recomiendo leer el reporte “El uso de algoritmos en el sector público en España: cuatro estudios de caso sobre ADMS” que Digital Future Society publicó el año pasado que desglosa casos en los que se usaron herramientas basadas en IA de manera irresponsable para determinar si se tiene derecho a una subvención nacional de la factura eléctrica o para calcular el riesgo de reincidencia de los reclusos en Cataluña o para predecir el riesgo de volver a ejercer violencia de género por parte de la Policía Nacional, afectando negativamente a millones de ciudadanos.

Imagen superior: Catherine Breslin / Better Images of AI / Silicon on Black 1 / CC-BY 4.0

¿Para qué le puede servir a un diseñador o a un futuro diseñador este máster?

Andrés Colmenares: El Máster no está pensado únicamente para diseñadores profesionales. Al ser una experiencia de aprendizaje colectiva centrada en investigar la IA como sistema sociales y técnicos es por naturaleza transdisciplinar. El Máster para el Diseño de IA Responsable es también para periodistas, comunicadores, productores culturales, ingenieros y particularmente para diseñadores que trabajan en el sector digital en interacción, experiencias, servicios, productos y estrategias . La definición de diseño que usamos en la creación de este programa es la de entender el diseño como verbo; diseñar entendido como una práctica cotidiana centrada en la toma de decisiones.

“El Máster es también para periodistas, comunicadores, productores culturales, ingenieros y particularmente para diseñadores que trabajan en el sector digital en interacción”.

Desde esta perspectiva el Máster es un contexto ideal para profesionales que quieran desarrollar habilidades en investigación creativa, análisis de contextos complejos, pensamiento crítico y diseño de narrativas para tomar decisiones estratégicas a través de investigar las múltiples formas en que los sistemas de Inteligencia Artificial están impactando nuestra vida diaria. Al identificar, analizar y decodificar la relación entre sistemas sociotécnicos y su impacto ambiental, cultural, social y ético, el Máster busca formar especialistas en diseño responsable de tecnologías relacionadas con la IA que puedan navegar sistemas complejos y así crear herramientas para que organizaciones y ciudadanos tomemos decisiones más responsable con respecto a la automatización y la digitalización de nuestras vidas.

El enfoque del máster ¿es teórico o también práctico? Brevemente ¿qué es lo que se va a tratar en la parte teórica? ¿Cómo va a ser la parte práctica?

Andrés Colmenares: Para entender mejor el enfoque del Máster para el Diseño de IA Responsable, hay que hablar de su origen como una colaboración entre Elisava y IAM, el laboratorio de investigación creativa que dirijo donde nos hemos especializado en el diseño de experiencias de aprendizaje colectivo; desde talleres y conferencias sobre futuros de internet a programas de aprendizaje experimental y pensamiento crítico para la UAL o residencias creativas para marcas como Red Bull. Estas experiencias fuera de la academia nos han enseñado que la clásica división entre teoría y práctica o entre pensar y hacer, no se corresponden con las complejas realidades y retos que enfrentamos en los 2020s. Por esta razón el Máster propone a los participantes una hoja de ruta para posicionarse como investigadores creativos con perspectivas interseccionales, críticas y constructivas más que como estudiantes pasivos que absorben contenidos estáticos o

“Experiencias fuera de la academia nos han enseñado que la clásica división entre teoría y práctica o entre pensar y hacer, no se corresponden con las complejas realidades y retos que enfrentamos en los 2020s abstractos”.

Esta hoja de ruta propone un marco teórico que comienza con establecer un co-laboratorio entre los participantes, profesores y colaboradores para investigar y debatir qué es la Inteligencia Artificial, cómo funcionan los sistemas de redes neuronales, Machine learning, herramientas generativas como ChatGPT así como la historia de la IA, las narrativas y aspectos filosóficos de este campo. También investigaremos cómo se están usando estas herramientas en varios sectores así como los usos más creativos de la IA desde perspectivas artísticas.

Más adelante entramos en contextualizar la IA como sistemas sociotécnicos, la dimensión de justicia social, las estructuras de poder que replica, su impacto medioambiental, la dimensión ética, su impacto cultural y el uso de IA en la emergencia climática.

En la segunda parte entramos de lleno en la IA Responsable, investigando las diversas iniciativas públicas y privadas para regular el sector, los principios, directrices y normativas desde perspectivas críticas, filosóficas y creativas. Esto nos permite conectar con el diseño de un proyecto final orientado en proponer metodologías, narrativas y herramientas para identificar y analizar riesgos o implementar estrategias de IA Responsable con un enfoque en explicar a otros ciudadanos como funcionan estos sistemas de manera creativa, colectiva y colaborativa.

Imagen superior: Fritzchens Fritz / Better Images of AI / GPU shot etched 5 / CC-BY 4.0

Impresión 3d, Criptomonedas, Metaverso, Nfts… parece que cada año aparece un palabra mágica que viene a cambiar el mundo, pero que el paso del tiempo las pone en su sitio y se dice que “no era para tanto” ¿Crees que con la IA puede pasar lo mismo? ¿Hay demasiadas expectativas puestas en esta tecnología? ¿Hay algo que haga de esta tecnología algo revolucionario?

Andrés Colmenares: Es bastante acertado referirse a estos términos como “palabras mágicas” que prometen cambiar el mundo. Vivimos en una sociedad digitalizada marcada por la economía de la atención que está perdida en abstracciones de la realidad material en las que las palabras cobran más valor por su repetición que por su significado.

Como decía al inicio de la entrevista, creo que el uso actual y dominante del término IA es bastante problemático porque refleja más una ideología (la tecnología como única y gran solución a todos los problemas de la humanidad) que una realidad. La mayoría de titulares dice que la IA hace esto y lo otro como si fuera una entidad única y autónoma. Pero esa IA no existe. Es un mito que esconde y aumenta el poder que las grandes corporaciones dedicadas a la extracción de datos (Meta, Microsoft, Google, Amazon, etc) tienen en la sociedad.

Un gran poder mayoritariamente ajeno a la gran responsabilidad que deberían tener considerando la escala de su impacto. Así que no tengo dudas que seguiremos oyendo el término IA por muchos años, así como hablamos de Matemáticas o Astronomía.

“La inteligencia artificial no es inteligente ni artificial”

Por otro lado, los desarrollos tecnológicos relacionados con la IA tienen tanto capital financiero como intelectual detrás que son imposibles de ignorar y como consecuencia ya tienen un impacto masivo principalmente a nivel de inversión. No estamos hablando de solo una tecnología. Cuando hablamos de IA hay varias tecnologías que convergen pero que igualmente dependen de recursos humanos y materiales limitados. No podemos ignorar que herramientas mágicas como ChatGPT, al igual que plataformas como Facebook, funcionan porque miles de personas en países con economías precarias hacen tareas de moderación de contenidos en condiciones bastante cuestionables.

Y que los gigantes centros de procesamiento de datos son cada vez más rechazados por ciudadanos que no están dispuestos a asumir el impacto medioambiental que estas tecnologías tienen.

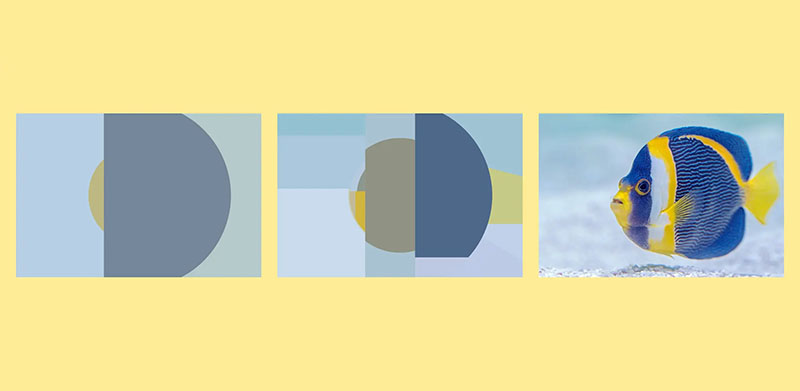

No podemos olvidar que en esencia, internet y en consecuencia los sistemas IA funcionan gracias al agua que enfría los servidores, los minerales escasos que componen los circuitos. En las sabias palabras de la investigadora de IA Kate Crawford, “la inteligencia artificial no es inteligente ni artificial”.

Imagen superior: Rens Dimmendaal & David Clode / Better Images of AI / Fish / CC-BY 4.0

Dicen que el impacto va a ser parecido a la llegada de internet ¿lo ves así? ¿O simplemente va a ser otra herramienta más?

Andrés Colmenares: Internet no llegó. Internet en esencia son infraestructuras de redes conectadas. Lo que llegó poco a poco en algunos lugares y más rápidamente en otros fue la conectividad a esas infraestructuras fomentando y facilitando la adopción masiva de dispositivos (ordenadores y teléfonos móviles) con software diseñado para usar esas infraestructuras, principalmente navegadores para “navegar” la World Wide Web.

En esta versión de la historia, la adopción de herramientas y sistemas basados en IA, es un capítulo más de la conectividad que ha derivado en la automatización y digitalización de nuestras vidas, para bien y para mal. En pocas palabras, la mayoría de herramientas de IA como ChatGPT no funcionan si no hay internet. No son autónomas. Dependen de muchos servicios, redes, centros de procesamiento de datos, y sobre todo de capital social, cultural y financiero.

Muchas personas temen que vaya a desparecer su trabajo creativo por la aparición de IA. ¿Qué piensas de esta afirmación?

Andrés Colmenares: El mito de la IA robando puestos de trabajo, muchas veces ilustrado con robots humanoides que habitan una imaginación colectiva alimentada por años desde Hollywood, es eso. Un mito. Los mitos son poderosos porque son una fina mezcla de realidad y fantasía creada con la intención de ejercer cierto control o poder atacando los miedos de las personas.

En el caso concreto del auge y adopción de herramientas de IA generativa como ChatGPT, no podemos olvidar que ChatGPT y otras herramientas similares son productos comerciales. Sus fabricantes quieren que sean herramientas adoptadas universalmente como en su momento Microsoft lo consiguió con Office o Adobe con Photoshop y ser un monopolio. En algunos contextos, esas herramientas pueden hacer tan eficientes ciertos procesos creativos que puedan resultar en cambios de los equipos y perfiles.

En otros contextos, aparecerán nuevos puestos de trabajo para especialistas en usar estas herramientas. Es verdad que en varios sectores existe una tendencia hacia la automatización derivada de una reducción de gastos. Propia de la especulación y la burbuja de inversión en empresas tecnológicas de los últimos años.

Así que esta profecía, desde mi punto de vista, es más una realidad disfrazada de fantasía reflejada más en los despidos masivos en el sector Tech. Que en la idea de herramientas que reemplacen la creatividad, impredictibilidad o también la bella estupidez de un ser humano.

¿Qué tipo de perfiles tienen los profesores que van a intervenir en el máster?

Andrés Colmenares: Hemos invitado un grupo amplio de profesionales trabajando en contextos diversos para formar la facultad del Máster que incluyen expertos en ética y diseño como Ariel Guersenzvaig, especialistas en innovación responsable. Filippo Cutica que lideró la estrategia de uso ético de tecnologías emergentes de la BBC o el investigador de sistemas sociotécnicos de la Arizona State University Martín Pérez Comisso.

También expertas en el impacto socioecologico de internet como Michelle Thorne de la Green Web Foundation. Investigadoras en governanza de sistemas IA como Buse Çetin. Diseñadoras especializadas en usos creativos de tecnologías digitales como Nadia Piet, fundadora de AIxDesign y Simone Rebaudengo, co-fundador de oio studio,

De igual manera especialistas en ética digital como Abdelrahman Hassan que trabaja en el área de Responsable AI de IKEA

Por último, artistas reconocidas en el ámbito del impacto social de las tecnologías como la escritora Xiaowei Wang, autora de “Blockchain Chicken Farm” y Caroline Sinders, creadora del emblemático Feminist Data Set.

Imagen superior: Andrés Colmenares fotografiado por Jan Phoenix

Cuál es tu experiencia laboral y académica, háblanos de ti.

Andrés Colmenares: Nací en Bogota, Colombia en 1982 donde inicie mi carrera profesional estudiando Publicidad mientras trabajaba como diseñador web haciendo páginas web en Flash en los 2000s. Cuando me gradué trabajé como consultor estratégico en campañas de publicidad digital y desde 2008 decidí enfocarme en investigación de tendencias. En 2009 me traslado a Barcelona para hacer una especialización en este campo y desarrollar mi primera empresa: wabi-sabi lab y en paralelo desarrollé para una agencia pequeña una plataforma de contenidos y red de creativos para Absolut (Absolut Network).

En 2015 junto con mi socia Lucy Black-Swan fundamos IAM. Exploramos los futuros de internet y el impacto de la economía digital a través de una series de conferencias (IAM Weekend) . Desarrollamos proyectos con organizaciones como Tate, UAL, BBC, Red Bull, SPACE10, Mobile World Capital y más recientemente con WeTransfer, diseñando su iniciativa filantrópica Supporting Act Foundation. Mi interés por la IA tiene como origen múltiples colaboraciones y diálogos con el artista Sergio Albiac, que hace arte generativo hace años y más recientemente a través de mi rol en el diseño del programa Digital Future Society, donde diseñamos el prototipo de un toolkit para uso responsable de IA en el sector público.

De los tres meses que llevamos en 2023, la evolución y proyectos que han aparecido en el mercado ha crecido de forma exponencial. ¿Cómo afectará al máster estos cambios diarios constantes?

Andrés Colmenares: El programa de Máster responde al siguiente mantra que ha guiado mi práctica: la única constante es el cambio. Panta rhei. En las sesiones, que inician a finales de Septiembre, buscamos investigar y estudiar la IA más allá del ruido de los hypes de cada herramienta nueva, identificando patrones en cada novedad y analizando el contexto de cada herramienta o sistema.

Buscamos crear las condiciones para que el grupo de profesionales que participe en cada edición. De esta forma tener una visión global del estado del arte de estas herramientas y también desarrollar un posicionamiento crítico y aterrizado en un contexto social concreto alineado con sus intereses. Ofreceremos una experiencia de aprendizaje colectivo muy a la medida de cada grupo. Creemos que los retos de los 2020s demandan formas alternativas de intercambiar, producir y compartir conocimiento. Por esta razón seremos más un grupo de investigadores que de estudiantes.

Más información sobre Máster en Diseño para una Inteligencia Artificial Responsable

Becas del 50% del importe hasta el 10 de abril 2023, más info aquí